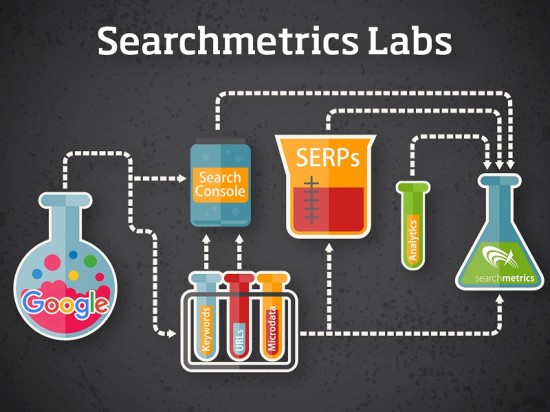

Mithilfe von externen Daten wie aus der „Google Search Console“ – einem kostenlosen Webservice von Google – oder aus Analytics-Systemen wie Adobe oder Google Analytics ist die Analyse verschiedener relevanter Search-Metriken der eigenen Domainperformance für Webmaster möglich. Diese Daten sind sehr wertvoll und deshalb ermöglichen viele Anbieter – auch wir – deren Integration ins eigene System. Doch eine wirklich relevante Analyse geht weit darüber hinaus.

Bereits seit längerem sind Daten aus den Google Webmaster Tools, mittlerweile in „Google Search Console“ (GSC) umbenannt, zum Teil über Umwege, exportierbar.

Und nach den Änderungen an der GSC API im August 2015 lassen sich zudem mehr Daten deutlich komfortabler in eigene Systeme integrieren.

Auch wir nutzen, bereits seit 2009, Daten aus der Search Console und ermöglichen deren Integration in den Projektbereich der Searchmetrics Suite, ebenso wie Analytics Daten von Google, Adobe & Co.

Wirklich relevante Search-KPIs?

Das ist jedoch nur der erste Schritt. Hier 3 Dinge, die in diesem Zusammenhang wichtig sind:

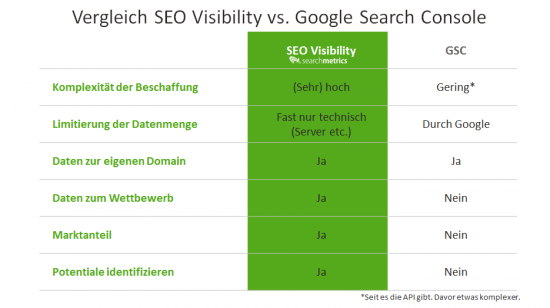

1) Die Arbeit mit bzw. die reine Übernahme von vorhandenen Daten allein bringt mir keine neuen Erkenntnisse und keine Informationen über Potenziale. Quasi sind das Dinge, die ich eh schon weiß.

2) Ich erhalte zwar Daten über meine eigene/n Domain/s, aber keine Insights zu meinem Wettbewerb oder Marktanteilen – was dazu führt, dass ich potenziell in die Irre geführt werde. Usain Bolt würde bei Olympia die 100 Meter ja auch nicht ohne andere Sprinter laufen.

3) Mit einem zu großen oder gar alleinigen Fokus auf eine externe Datenquelle mache ich mich zu sehr von Dritten abhängig.

Erst wenn ich also in einem nächsten Schritt Daten kombiniere bzw. neue, eigene Berechnungen durchführe, erhalte ich Insights, die ich vorher noch nicht hatte!

Externe Daten – die Pflicht

Der Export bzw. die Integration von Google Search Console Daten löst das Problem, dass diese in der Search Console nach 90 Tagen gelöscht werden. Jedoch wird prinzipiell nur ein Teil der Daten angezeigt. Um diese Limitierung zu umgehen sind jedoch komplizierte Workarounds nötig.

Zum Thema, wie man die Möglichkeiten der GSC und der Search Analytics API nutzen kann, gibt es übrigens einen sehr schönen, ausführlichen Blogbeitrag von Takevalue.

Die Grenzen der GSC-Daten

Wo die Grenzen der Google Search Console liegen und warum die Daten nicht perfekt sind, zeigt etwa dieses Beispiel von “Datensalat” nach einer Umstellung auf HTTPS (siehe Screenshot).

“Nach der Umstellung auf HTTPS hat die Google Search Console im Non-HTTPS-Account weiterhin alle Impressions gezählt, jedoch keine Klicks mehr.”

Christoph Burseg, Geschäftsführender Gesellschafter der Massive Insights GmbH

Na klar lässt sich prinzipiell sagen: Lieber einige Daten als gar keine Daten! Das Problem ist ja auch bezüglich „not provided“ nicht neu. Doch sind die not-provided-Daten in der GSC nun wirklich wieder provided? Nein, sind sie nicht. Möglicherweise sind die Daten veraltet bzw. inkonsistent in einem Pool, so dass man nicht mehr weiß: was gehört wohin? Da die Daten ja auch kostenfrei von Google zur Verfügung gestellt werden, gibt es gar keinen Anspruch der Nutzer auf Aktualität oder Konsistenz dieser Daten (wie etwa beim HTTPS Beispiel).

Die GSC API ist für Google kein strategisches Projekt. Dadurch kann es jederzeit passieren, dass es wie andere Projekte einfach pausiert oder eingestellt wird. Das kann auch bei populären Projekten passieren, wie die Einstellung des Google Readers 2013.

Eigene KPIs – die Kür!

Erst durch eine Kombination und Weiterverarbeitung von mehreren, auch eigenen Datenquellen zu individuellen Kennzahlen werden neue Analyse-Möglichkeiten erschlossen. Doch hierfür sind Big Data, eigene Daten und vor allem eigene Berechnungen und KPIs nötig.

Benutzt Searchmetrics die GSC-Daten (vorher Google Webmaster Tools)?

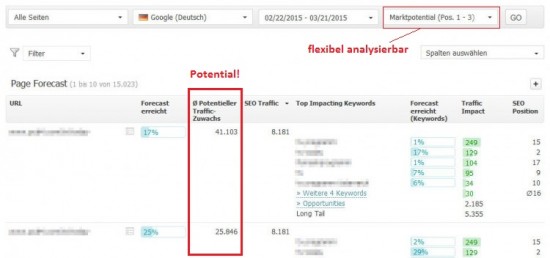

In der Suite benutzen wir die Daten der Google Webmaster Tools, jetzt Search Console, unter anderem schon seit November 2013 für unseren Traffic-Insight oder auch der darauf basierende Page-Forecast. Was wir dabei jedoch anders machen ist, dass wir die externen Daten mit unseren eigenen Daten verheiraten.

Wir halten beispielsweise Potenzial-Analysen (Low-Hanging-Fruits!) und Vergleiche mit dem Marktumfeld für sehr wichtig im SEO-Alltag. Also Antworten auf Fragen wie:

- Inwiefern schöpfe ich mit welchen URLs meine Möglichkeiten aus?

- Wie performt mein Wettbewerb und was sind deren Strategien?

- Wo lohnt es sich als erstes, mit der Optimierung anzusetzen/ wo liegt das meiste Potenzial?

- Wie kann sich mein Traffic auf Keyword- und Page-Basis entwickeln, wenn ich mich ein paar Positionen verbessere oder überall auf 1 ranke?

Diese Möglichkeiten ergeben sich nur, wenn man Daten verbindet, was andere heutzutage nicht machen.

Relevante Searchmetrics KPIs – Beispiele

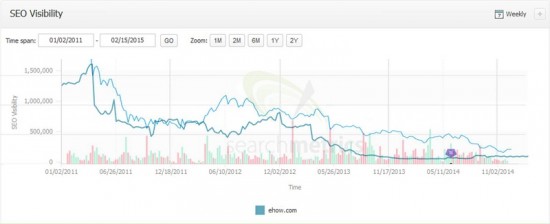

1. SEO Visiblity

Die SEO Visibility fungiert nicht als 1:1 Traffic-Kennzahl, sondern als zwar komplex berechnete, aber einfach darstellbare und interpretierbare Metrik, die unter Berücksichtigung verschiedenster relevanter Search-Kennzahlen die Sichtbarkeit einer Domain in den organischen Suchergebnissen abbildet, sowie deren:

- historische Entwicklung und

- Vergleich mit anderen Domains – auf derselben Datenbasis – ermöglicht.

Wenn auch kein Realabbild, so ist die SEO Visibility dennoch ein sehr guter Indikator für den Suchmaschinen-Traffic einer Website. Die Spearman-Korrelation des Trends von SEO Visibility und mit Web-Tracking-Software gemessenem Google-Traffic liegt bei über 0.9!

Korrelation mit Traffic

Martin Mißfeld hat vor einiger Zeit einen interessanten Vergleich von echtem SEO-Traffic mit Visibility-Kennzahlen veröffentlicht, der auf dreien seiner privaten Projekte beruht. Hier, auch wenn aus dem Zusammenhang gerissen, ein Zitat aus dem Fazit:

„Die proportionalen Veränderungen stimmen bei Searchmetrics eher mit den Seo-Traffic-Veränderungen überein. Ursache ist wahrscheinlich das größere Keywordset.“

SEO Visibility vs realer Börsenkurs

Das wahrscheinlich interessanteste Beispiel für die Aussagekraft der SEO Visibility ist der Vergleich der historischen Entwicklung der SEO Visibility von ehow.com und des Aktienkurses von Demand Media. ehow wohlgemerkt ist deren wichtigestes Zugpferd und sehr abhängig von Suchmaschinentraffic. So ist es kein Wunder dass die SEO Visibility sehr schon mit dem Börsenkurs korreliert.

2. Potenziale: Wissen, was man nicht weiß!

Was bringt es mir also im Falle der reinen Integration von externen Daten in andere Systeme, zu wissen, was ich schon weiß? Es geht doch vielmehr darum, zu wissen, was ich noch nicht weiß!

Diesen Schritt gehen wir mit der Searchmetrics Suite, indem wir im Traffic-Bereich bereits seit 2013 u.a. die Google Search Console Daten mit den Web-Tracking-Daten (Google Analytics usw.) verheiraten um Not-Provided zu reduzieren. Doch dafür reichen die GSC-Daten nicht.

“Erst durch die Kombination mit der Research Cloud von Searchmetrics werden die Daten der Google Search Console richtig wertvoll.”

Benjamin Gottbehüt, SEO-Manager

Externe Daten x Eigene Daten = relevante Analysen!

Zusammengefasst: Die Integration externer Daten ist sinnvoll und empfehlenswert. Bei den Daten aus der API der Google Search Console ist deren zeitliche und quantitative Limitierung ein Problem, das zumindest was die historische Verfügbarkeit angeht durch deren Export teilweise gelöst werden kann. Gefährlich in jedem Fall ist die Abhängigkeit von Dritten, da man deren Willkür ausgesetzt ist.

Doch allein bringt es mir nicht viel, angezeigt zu bekommen, was ich schon anderswoher weiß. Individuelle Berechnungen und KPIs unter der Kombination verschiedener relevanter Parameter auf Basis von Big Data können so viel mehr als reine GSC-Daten.

Die Anreicherung sowie die Erweiterung von externen Daten mit eigenen Daten ist also immens wichtig, um etwa Potenziale zu erschließen. Relevante, unabhängig berechnete KPIs wie die SEO Visibility sind und bleiben deshalb ein wichtiger Teil des Großen und Ganzen, denn allein auf vorhandenen externen Daten zu analysieren, reicht einfach nicht. Zu wissen, was ich noch nicht weiß, das ist doch das Ziel!