Zum Deutschlandstart von Google Home hatte ich im August 2017 die drei Sprachassistenten Siri, Cortana und eben Google Home auf ihre Praxistauglichkeit überprüft. Die Qualität von Google Home hatte mich als damaligen Siri-Poweruser dabei so sehr überzeugt, dass ich mir ein Gerät gekauft habe. Nun, sieben Monate später, habe ich den Test wiederholt: Was soll ich sagen? Die Google Voice Search ist noch deutlich besser geworden!

Schon in meinem ersten Test „Hey Siri, bestell mir ein Google Home“ – Sprach-Assistenten im Praxistest lag das Gerät von Google mit deutlichem Abstand vor den Voice Search Assistenten von Apple und Microsoft. Dieser Abstand hat sich nun noch einmal deutlich vergrößert, denn während sowohl Siri als auch Cortana sich in Sachen prozentual (sinnvoll) beantworteter Fragen kaum entwickelt haben, hat Google Home noch einmal deutlich dazugelernt.

Ich werde übrigens am 25.04. um 15:30 ein Webinar mit Bastian Grimm von Peak Ace zum Thema Voice Search und Sprachassistenten im Fokus: “Ok Google, nenn mir Optimierungspotenziale!” halten. Wer Lust hat, schaut vorbei:

Zum Webinar “Voice Search” anmelden

Hier noch einmal kurz zum Versuchsaufbau des Praxistests:

Reminder: Versuchsaufbau und Fragen

Erneut habe ich (dieselben) 100 Fragen mit monatlichem Suchvolumen zwischen 2.000 und 180.000 verwendet und an allen digitalen Assistenten in meinem Haushalt getestet. Untersucht habe ich Google Home, Microsoft Cortana auf meinem Windows-Computer und Siri auf meinem iPhone.

Das Gesamtergebnis – und die Trends zum vorigen Test – im Überblick

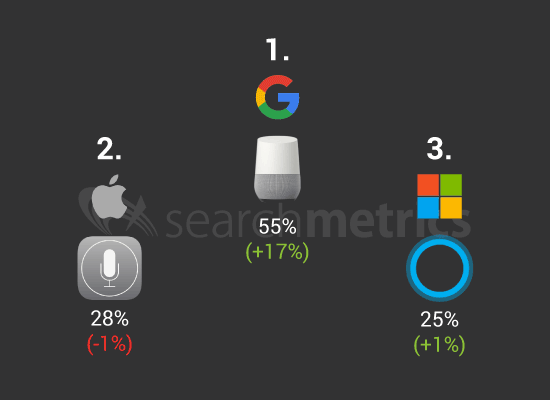

Die Podiumsverteilung ist zwar auf den ersten Blick identisch – doch dahinter hat sich viel getan: Google Home ist erneut eindeutiger Sieger des Voice-Search-Praxistests – hat jedoch seine Antwortquote innerhalb von nur sieben Monaten um 17% steigern können.

Damit beantwortet Google mittlerweile fast doppelt so viele Fragen wie das zweitplatzierte System Siri, dass sogar 1% einbüßt. Cortana liegt zwar weiterhin auf dem dritten – und damit in diesem Test letzten – Platz, hat sich jedoch um 1% verbessert und beantwortet jetzt jede vierte Frage korrekt.

Die Ergebnisse und Voice Search Entwicklungen im Detail pro Sprachassistent:

1. Google Home – Google/Alphabet

Interessanterweise hat das Gerät Fragen verlernt! Zum einen Fragen, die der Knowledge Graph beantworten können müsste, wie „Wann ist Fasching“ und zum anderen diverse Fragen aus dem Medizin-Bereich oder „Wann kann ich in Rente gehen“, die früher über Website-Zitate beantwortet wurden.

Insbesondere für Keywords/Phrasen/Fragen, die über ein hohes mobiles Suchvolumen verfügen (und demzufolge theoretisch auch öfter per Voice Search durchgeführt werden), haben sich die Antwortquoten bei Google Home jedoch deutlich verbessert. Darüber hinaus hat das System beim Beantworten von Fragen hinzugelernt, für die es noch keine Direct Answers und/oder Featured Snippets gab und gibt.

Außerdem kann Google Home jetzt Actions/Skills/Apps starten, zum Beispiel TV Spielfilm für TV oder eine Mondphasen-App. Auch was die Antworttypen anbetrifft, hat Google Home sich entwickelt, so wurde zum Beispiel 4x öfter eine menschliche/lustige Antwort gegeben und 8x öfter Wikipedia explizit als Quelle genannt.

Offensichtlich hat das System noch Schwierigkeiten mit der Interpretation von TV versus Fernsehen:

- Frage: Was kommt heute im Fernsehen

Google Home Antwort/Aktion: TV-Spielfilm-App - Frage: Was läuft heute im TV

Google Home Antwort/Aktion: Veranstaltungen in der Nähe - Frage: Was läuft im TV

Google Home Antwort/Aktion: Ich finde keine Cast-Geräte - Frage: Was kommt heute Abend im Fernsehen

Google Home Antwort/Aktion: Entschuldigung, TV-Programme werden noch nicht unterstützt.

2. Siri – Apple

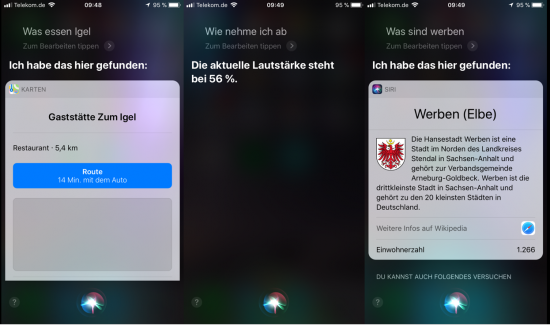

Bei Siri gibt es im Prinzip keine Veränderung. Das System hat sogar teilweise Fragen verlernt. Die Antworten gehen oft sogar komplett am Thema vorbei, zum Beispiel bei “Was essen Igel“, “Wie nehme ich ab” oder “Was sind Verben“.

3. Cortana – Microsoft

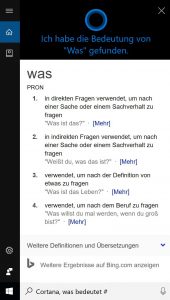

Generell verfügt Cortana jetzt über eine deutlich bessere Spracherkennung als noch vor 7 Monaten und versteht mittlerweile die meisten Fragen. “2016” und “Tinder” kann das System aber immer noch nicht interpretieren. Genauso wenig wie “Was bedeutet #“. Die Phrase wird durch das System zu “was bedeutet” verkürzt, also erklärte Cortana mir, was “was” bedeutet.

Was konkret die Antworten angeht, gibt es bei Cortana jedoch keine sichtbare Verbesserung. Zwar werden nur noch in etwas über 60% (statt vorher 70%) aller Fällen Bing-Suchen ausgeführt, aber das liefert leider auch nicht mehr verwertbare Antworten. Zum Beispiel wird jetzt öfter der entsprechende, zur Frage passende Wikipedia-Artikel angezeigt Jedoch schafft Cortana es nicht, den für meine Frage relevanten Teil des Artikels anzuzeigen.

Cortana erreicht die gute Bewertung übrigens auch nur, weil ich akzeptiert habe, dass das System dachte, ich sei in Aachen (statt in Berlin).

Ergebnisse im Detail – Einfluss von Suchintegrationen und Fragewörtern

Knowledge Graph

Google Home beantwortet mittlerweile ALLE Fragen (100%), für die es bei google.de eine Knowledge-Graph-Integration gibt, korrekt. Im vorherigen Test waren es schon 80%. Hier nun also volle Punktzahl.

Siri (von 60% auf 50%) und Cortana (von 60% auf 57%) haben sich hier demgegenüber leicht verschlechtert.

Direct Answer / Featured Snippet

Auch bei der Beantwortung von Fragen, für die eine Direct Answer oder ein Featured Snippet in den Suchergebnissen eingebunden wird, hat Google Home die Quote von 66% auf 72% gesteigert, während es bei Siri (17%) keine Entwicklung gab und Cortana (von 21% auf 17%) sich hier verschlechtert hat.

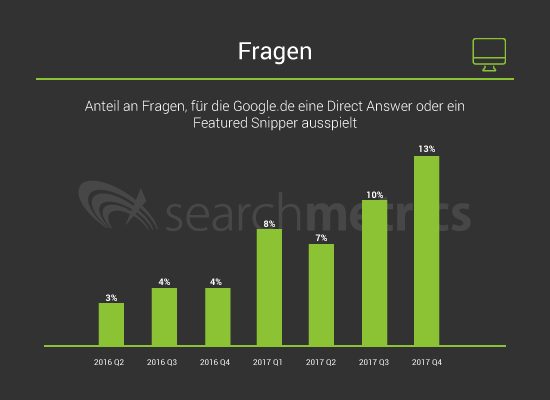

Übrigens habe ich auch frische Zahlen mitgebracht, was die Anteile an Fragen angeht, für die Google eine Direct Answer oder ein Featured Snippet ausspielt. In der untenstehenden Grafik ist die Entwicklung der Einbindung von Direct Answers und Featured Snippets im Zeitraum, von Q2/2016 bis Q4/2017, für ein Keywordset von mehreren tausend Fragen dargestellt.

In den USA (google.com) war der Anteil auf einer ähnlichen Datenbasis im letzten Quartal 2017 bereits bei 33%.

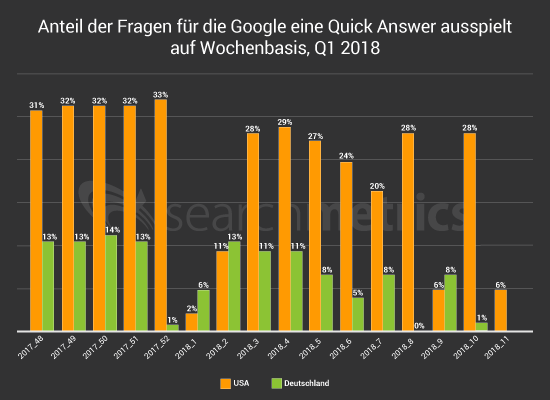

Randnotiz: Seit der ersten Januar Woche springt der Anteil der Fragen, die Google direkt in den SERP beantworten kann, übrigens von Woche zu Woche massiv. In Deutschland zwischen 0% und 13%, in den USA zwischen 2% und 29%. Im gleichen Datenset wird der Knowledge Graph (als Panel auf der rechten Seite) deutlich konstanter ausgespielt. In Deutschland springt der Wert zwischen 6% und 7%. In den USA zwischen 10% und 12%. Das heißt, Google experimentiert hier ganz klar mit den Quick-Answer-Elementen. Dazu passt auch das aktuelle Zero-Results-Experiment.

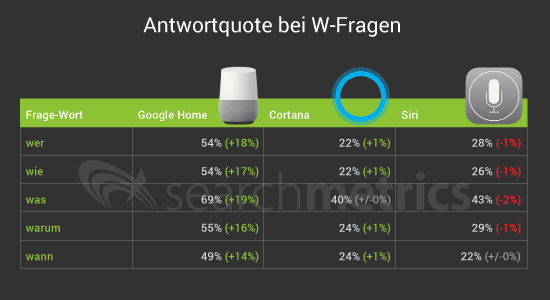

W-Fragen

Alle drei Systeme können immer noch Was-Fragen deutlich häufiger als alle anderen Fragen beantworten. Im Mittelwert wurden 51% (+6%) aller Was-Fragen beantwortet, und nur 34% aller Nicht-Was-Fragen. Jedoch hat sich auch bei Nicht-Was-Fragen die Antwortquote verbessert (+4%).

Weiterhin liegt Google Home hier bei allen W-Fragen klar vorn – und konnte sich auch im Vergleich aller Systeme am deutlichsten verbessern. Siri hingegen hat durch die Bank weg verlernt.

Overlap – richtig und falsch beantwortete Fragen

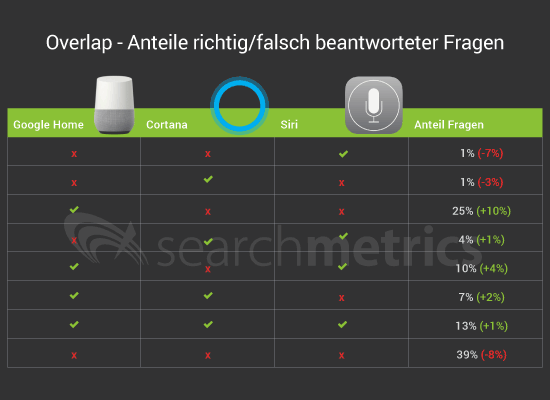

Alle drei Sprach-Assistenten sind nur noch an 39 (vorher: 47) Fragen gescheitert und konnten 13 (vorher: 12) Fragen korrekt beantworten. Bei den restlichen 41 Fragen lag Google Home am häufigsten richtig. Zusammen konnten Cortana und Siri nur noch insgesamt 6 (vorher: 15) Fragen beantworten, auf die Google Home keine Antwort wusste. Konkret sieht die Verteilung, inklusive der Trends, jetzt so aus:

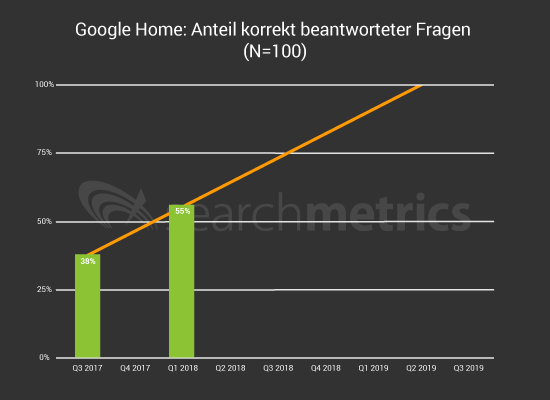

Spoiler: 2019 weiß Google ALLES

Ich habe mir den Spaß gemacht, und die Entwicklung von Google Home der letzten Monate skaliert, um eine Prognose zu machen, wann das System – bei gleichbleibender absoluter Verbesserungsquote (ich weiß, dass das in der Praxis anders aussehen wird) – alle Fragen korrekt beantwortet – Spoiler: im zweiten Quartal 2019 dürfte es soweit sein:

Wer jetzt noch mehr Lust auf mein Webinar hat, hier nochmal der Link:

Zum Webinar “Voice Search” anmelden

Fazit: Ich habe den Google-Home-Kauf nicht bereut

Meine drei Gesamt-Takeaways sind:

- Es gibt mittlerweile deutlich weniger Fragen, auf die kein Device die Antwort weiß.

- Demgegenüber gibt es jetzt mehr Fragen, auf die alle Devices Antworten konnten.

- Insgesamt gibt es deutlich mehr Fragen, die nur Google beantworten kann – und entsprechend weniger Fragen, die nur Siri oder Cortana beantworten können.

Wenn ich nicht schon ein Google Home hätte, würde ich mir spätestens jetzt eines kaufen.