Das Farmer-Update hat mich an mein Versprechen von Anfang des Jahres erinnert, dass ich auf einige Themen der Agenda 2011 zurück kommen wollte. Und gerade das Farmer-Update drängt einem ja geradezu die Frage nach der Zahl von sinnvollen Unterseiten im Index auf. Mein Tipp vor zwei Monaten: “Tipp #5: Welche Beitrags- und Navigations-Seiten sind wirklich “unique” mit eigenem Content und nutzen dem User? Alle anderen sollten mit geeigneten Mitteln aus der Indexierung genommen werden.”

Das Farmer-Update hat mich an mein Versprechen von Anfang des Jahres erinnert, dass ich auf einige Themen der Agenda 2011 zurück kommen wollte. Und gerade das Farmer-Update drängt einem ja geradezu die Frage nach der Zahl von sinnvollen Unterseiten im Index auf. Mein Tipp vor zwei Monaten: “Tipp #5: Welche Beitrags- und Navigations-Seiten sind wirklich “unique” mit eigenem Content und nutzen dem User? Alle anderen sollten mit geeigneten Mitteln aus der Indexierung genommen werden.”

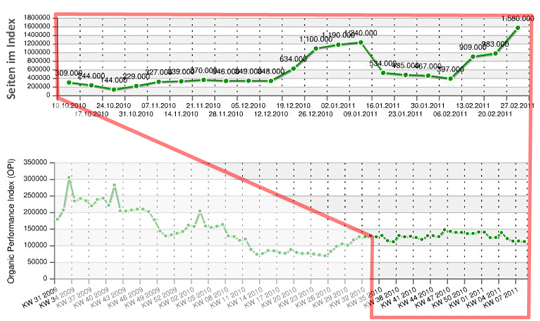

Zur Veranschaulichung hier die Kurven einer Kundenseite, die natürlich nicht genannt werden darf. Im oberen Bereich sehen wir die Entwicklung der Seitenzahl im Index seit Sommer vergangenen Jahres. Im unteren Bereich sehen wir die Entwicklung der Seite im organischen Index. Obacht: Die Zeitkurven sind unterschiedlich! Ich habe versucht, das mit dem roten Rahmen deutlich zu machen.

Und was sehen wir? Eigentlich das Gegenteil von dem, was viele erwarten: Je mehr Seiten im Index umso schlechter die Sichtbarkeit im organischen Index. Ooooops? Wie kommt denn das zustande?

Ganz einfach: Wer den Google Robot von seiner Arbeit (sinnvolle, keywordoptimierte Seiten zu verarbeiten) abhält, indem er ihm sinnlose Seiten ohne uniquen Inhalt vorwirft, muss mit den Konsequenzen leben. Denn das verbraucht seine Zeit und ärgert ihn möglicherweise auch. Nehmen wir doch der Einfachheit halber einfach mal an, dass Google einen durchschnittlichen Qualitäts-Wert aller Unterseiten errechnet und die Domain dementsprechend als Content-Farm, Artikelverzeichnis oder Qualitätsseite einstuft. Unwahrscheinlich? Nun, wir werden in den nächsten Wochen sehen.

Auf jeden Fall ist klar, dass wir dem Robot nur die Seiten zum Verarbeiten vorlegen, die wir auch im Index haben möchten. Dazu gehören nicht:

- Seiten mit einem überflüssigen Parameter in der URL (Session-ID, Referrer-ID u.s.w.)

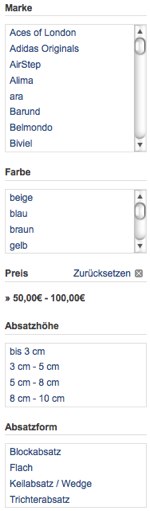

- Massenhafte Produktlisten aus verschiedenen Filterkriterien

- Paginierte Seiten in Rubriken

- Produktseiten mit Variationen (wenn es ein T-Shirt in 15 Farben gibt, alles andere gleich bleibt)

- Durch Permutation denkbare, aber inhaltleere Seiten (Wenn z.B. der Longtail durch Kombination von Attributen bedient werden soll, aber manche Kombinationen einfach nicht sinnvoll sind.)

Folgende Mittel können wir zur Behandlung dieser Seiten zum Einsatz bringen:

- Diese Seiten erst gar nicht entstehen lassen (Permutationen vorher filtern, Session-IDs gehören eh nicht mehr in die URLs!)

- “noindex” im Robots-Metatag: Damit teilt man dem Robot mit, dass die Seite nicht indiziert werden soll. Dies sollte zur Sicherheit bei massenhaften Produktlisten erfolgen. Aber nicht vergessen: Einige dieser Listen sind sinnvoll – diese also nicht noindexieren!

- “noindex,follow” im Robots-Metatag: Hiermit verbieten wir zwar dem Robot, diese Seiten in den Index aufzunehmen – aber den Links darauf soll er trotzdem folgen. Das machen etwa bei paginierten Seiten und immer da, wenn diese Seiten für die Verteilung des Linkjuice verantwortlich gemacht werden.

- Einsatz des Canonical-Tag in den Meta-Tags: Das machen wir immer dann, wenn eigentlich eine andere Seite gemeint ist. Etwa die vielen verschiedenen T-Shirts, die sich nur durch ein Detail unterscheiden. Oder wenn das System irgendwelche Parameter an die Seite klebt. Dann mache ich einen Canonical-Tag auf die “eigentliche” URL.

- robots.txt: Wenn wir ganze Verzeichnisse (“/suche/”) nicht im Index haben möchten, dann können wir das auch in der robots.txt angeben. Allerdings funktioniert das dann nicht bei Seiten, die z.B. von außen einen Link bekommen. Diese bleiben im Index. Aber das könnte ja bei dem Beispiel “Suche” durchaus gewünscht sein…

- “Parameterbehandlung” in den Google Webmaster Tools: Hier kann man die o.g. Parameter auch auf “ignorieren” oder eben “nicht ignorieren” stellen. Das funktioniert ganz gut – allerdings empfehle ich nicht, dies zu hoffen, dass damit alles o.k. ist. Das könnte ein Fehler sein.

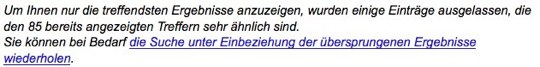

So, und wer jetzt glaubt, das hat ihn alles nicht zu interessieren, der soll doch bitte selber nachprüfen, ob er doppelte und sinnlose Seiten im Index hat. Man schnappe sich von verdächtigen Seiten ein Stückchen Text und suche danach in Kombination mit dem Site-Befehl (also: “site:domain.de textschnipsel”) Erscheint auf einer der SERPs-Seiten der Hinweis auf einen Filter (siehe Bild), dann wird es Zeit für eine Seiten-Konsolidierung.

P.S.: Wer schreibt denn hier? Mein Name ist Eric Kubitz und ich bin Mit-Gründer der CONTENTmanufaktur GmbH. Wer mich erreichen will, kann dies per Mail (ek@contentmanufaktur.net) oder per Twitter tun. Bis bald!