Google lockert die Fesseln: Dank Penguin 4.0 konnten zahlreiche Websites, die in der Vergangenheit in den u.a. auf Webspam und Backlinkstruktur fokussierten Filter gerutscht waren, gewaltig an SEO Visibility zulegen. Backlink-Audit, Negative SEO und Link-Bewertungen – in diesen Bereichen werden langfristige Auswirkungen des jetzt im Kernalgorithmus integrierten Penguins zu erwarten sein.

Bei vielen Webmastern sorgten die verschiedenen Iterationen der Penguin-Updates seit dem Jahr 2012 immer wieder für Aufsehen. Wurden Websites wegen Linkspam durch den Penguin abgestraft, dann konnte es mitunter dauern, bis eine Erholung der Seite einsetzte. Zwar gab es Domains, die durch eine Änderung der Linkstruktur recht schnell wieder Luft atmen konnten. Doch gab es ebenso zahlreiche Beispiele, bei denen eine Erholung bis zum diesem aktuellen Penguin-Update andauerte – das bedeutete mehr als 3 Jahre in der Penalty…

Was ist Penguin 4.0?

Die neue Version beendet nun das Warten. Penguin 4.0 ist nun laut Google Teil des Kernalgorithmus der Suchmaschine. Damit werden die Penguin-Daten, die der Google-Bot beim Crawlen der Website in Bezug auf Links feststellt, in Echtzeit aktualisiert. Google spricht dabei von „Spamsignalen“, die beim Crawlen auffallen – dies kann also neben Links auch Keyword-Stuffing oder Cloaking betreffen. Dies bedeutet, dass Google Signale aus anderen Update-Paradigmen – wie etwa dem Panda – zusammenfasst.

Flexiblere Bewertung und Auswirkungen in Echtzeit

Mit Penguin 4.0 verabschiedet sich Google von groß angekündigten Updates. Denn inzwischen sind die wichtigsten Elemente, mit denen Google Websites evaluiert, in den Kernalgorithmus integriert und werden in Echtzeit bewertet. Nachdem mit Hummingbird und RankBrain ein Echtzeit-Verständnis von Suchintention und entsprechend passenden Ergebnissen in den Algorithmus eingeflossen ist, sind nun auch Panda und Penguin ein Teil des Kern-Algorithmus von Google, der auf datengetriebenem Machine Learning basiert. Hintergrund ist, dass einer von Googles wichtigsten Forschungsschwerpunkten auf dem Weg zum relevantesten Suchergebnis die (Weiter-)Entwicklung im Bereich der Künstlichen Intelligenz (KI) ist.

Nun URL-basierte statt domainweite Effekte

Ebenfalls gravierend ist die Neuerung, dass Penguin 4.0 nun URL-basiert arbeitet – und nicht mehr domainweit wie bei vorigen Iterationen. Wer aufgeräumt hat, ist aus dem Filter entkommen und hat einen Boost erfahren. Doch auch Websites, die ihre Backlink-Struktur nicht bereinigt haben, konnten zulegen. Veränderungen betreffen dann nur die einzelne URL und nicht mehr die komplette Website. Entsprechend gibt es auch weniger eindeutige Verlierer, weil diese Websites nicht mehr domainweit mit einem Filter belegt wurden.

Analyse der Auswirkungen von Penguin 4.0

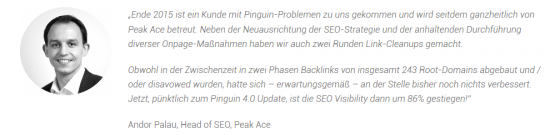

Searchmetrics-Kunden berichten von entsprechenden Auswirkungen des Updates, etwa Andor Palau, Head of SEO bei der Berliner Agentur Peak Ace, die Searchmetrics einsetzt. Er berichtet als Beispiel von einem Kunden, der mit Penguin-Problemen zu Peak Ace kam. Nachdem Link-Cleanups monatelang ohne Erfolg geblieben seien, stieg die SEO Visibility pünktlich zum Rollout von Penguin 4.0 massiv an:

Auch in unseren Daten vom 16. Oktober 2016 können wir die Auswirkungen des Rollouts von Penguin 4.0 in Deutschland beobachten. Entgegen der sonst üblichen Update-Tradition veröffentlichen wird heute keine Liste mit den Gewinnern bzw. Verlierern. Schließlich können wir – trotz immensen Crawling-Aufwands – nicht wissen, welche Links von einer Website disavowed wurden. Diese Information teilen die SEOs bzw. Webmaster dieser Webmaster exklusiv mit Google. Allerdings kann festgehalten werden: Bei den Top-Gewinnern der SEO Visibility finden sich zahlreiche Domains, bei denen der Visibility-Boost möglicherweise mit dem Penguin-Update zusammenhängen könnte.

Frühere Penguin-Verlierer haben sich erholt

Schauen wir uns nachfolgend jedoch zwei Beispiel-Domains an, die beim ersten Penguin-Update 2012 zu den Verlieren gehörten – und in den vergangenen beiden Wochen, da die Auswirkungen des Penguin-Updates sichtbar wurden, in ihrer Visibility deutlich zulegen konnten:

Die Horoskop-Website schicksal.com verzeichnete bei Penguin 1 einen gewaltigen Visibility-Abfall von rund 65 Prozent. Nach April 2012 konnte sich die Seite nur langsam erholen. Jetzt, so scheint es, gehört schicksal.com zu den großen Gewinnern des Rollouts von Penguin 4 – der Visibility-Zuwachs betrug mehr als 40 Prozent. Es könnte also sein, dass die Website in ihrer Backlinkstruktur aufgeräumt hat bzw. sich die Abschaffung des domainweiten Penguin-Filters jetzt positiv auf die Visibility der Horoskop-Seite auswirkt.

Ein weitere Domain, die wir als einen der Hauptverlierer bei Penguin 1 ausgemacht hatten, ist pkwteile.de. Die Domain hatte beim Update im Jahr 2012 rund ein Drittel an SEO Visibility eingebüßt. Vom Rollout des Penguin 4.0 scheint auch diese Website profitiert zu haben – die SEO Visibility legte innrhalb von zwei Wochen um gut 40 Prozent zu.

Einschränkend muss hinzugefügt werden, dass der Zuwachs von rund 40 Prozent bei den beiden Domains in absoluten Visibility-Punkten nicht so heftig ausfällt, weil es zwei kleinere Domains mit entsprechend niedriger Ursprungs-Visibility sind. Es wird sich also zeigen, ob die Visibility kontinuierlich zulegt, weil die “Fesseln” gelöst sind.

Update kündigte sich durch Crawling-Peaks des Google-Bots an

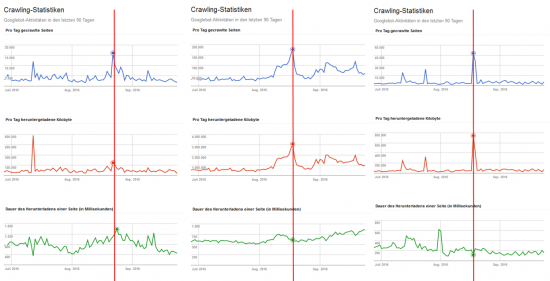

Bevor das Echtzeit-Update aktiv geworden ist, scheint Google aber zunächst eine Bestandsaufnahme von bestehenden Link- und Seiten-Strukturen im Netz durchgeführt zu haben. Darauf deutet eine bemerkenswerte Korrelation hin: Die Crawling-Aktivität von Google-Bots hatte kurz vor der offiziellen Kommunikation des Updates enorm zugelegt.

Es scheint, dass Google eine Art Status Quo der Link- und Seitenstrukturen im Netz erstellen wollte oder das kommende Update validieren wollte, um daraufhin den Echtzeit-Penguin von der Leine zu lassen.

Google-Bot crawlt beanstandete Signale aus früheren Penguin-Updates

Was zunächst überrascht, ist die hohe Anzahl von gecrawlten Seiten, der eine niedrige Download-Dauer gegenübersteht; dies ist im oberen Bild vor allem im rechten Beispiel zu erkennen. Dies könnte sich durch das vermehrte Crawlen von “alten” URLs erklären. Der Google-Bot crawlte entsprechend vor dem Ausrollen des Updates die beanstandeten Signale bzw. URLs, die zu früheren Penguin-Penaltys geführt hatten.

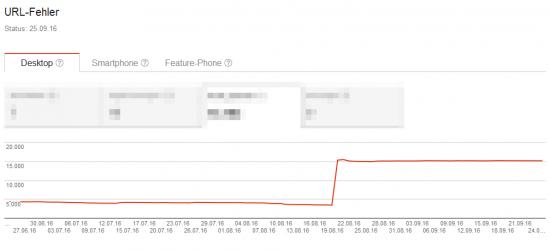

Zu sehen ist im Screenshot, wie die verstärkte Crawling-Aktivität mit einem Anstieg an 404-Fehlern einhergeht. Und eine nicht existente Seite braucht auch entsprechend wenig Crawling-Zeit.

Ausblick: Backlink-Audit schwieriger, aber wichtig!

Mit Penguin 4.0 werden künftig unsaubere Links nach ihrer Entdeckung durch den Google-Bot sofort als Signal für die spezifische URL gewertet bzw. disawowed – zumindest in der Theorie. Veränderungen betreffen künftig aber nur die einzelne URL und nicht die komplette Domain, wie dies bei früheren Penguin-Updates der Fall war.

Allerdings wird es damit auch schwieriger, Backlinks als Ursache für einen Abfalls der Visibility zu identifizieren. Werden etwa Ranking-Verluste für eine URL festgestellt, liegt es zunächst nahe, die Landingpage im Hinblick auf Content, Nutzerintention und Struktur zu optimieren. Wenn trotzdem keine Verbesserungen verzeichnet werden, könnte es am Backlinkprofil liegen, welches die konkrete URL nach unten zieht – ohne dass dies auf den ersten oder zweiten Blick auffällt. Etwa, weil es ein Mitarbeiter zu gut gemeint hat, ein Konkurrent schlechte Links streut oder beim Testing zufällig die Seite als Target ausgewählt wird. Künftig wird es also schwieriger, die Beurteilung von Links durch Google präzise zu bestimmen. Klar aber ist, dass es in Zukunft weniger “Negative-SEO” geben wird, denn man kann keine Domains mehr “abschießen”, indem viele schlechte Links auf diese “Gegner”-Websites gesetzt werden.

Mit Penguin 4.0 gehört der frühere taktische SEO-Blick auf Backlink-Aufbau oder einzelne Keywords der Vergangenheit an; langfristige Maßnahmen werden immer wichtiger. Ein kontinuierlicher Backlink-Audit muss ein fester Bestandteil im SEO-Jahresplan sein, um sich vor diesen negativen Signalen zu schützen. Ebenfalls sollte der Fokus auf der Etablierung einer Content-Strategie und der Produktion von relevantem, einzigartigem Content liegen, der die Nutzerintention perfekt bedient. Nur so wird die Website von Nutzern auch konsumiert, aktiv verlinkt, geliked und geteilt – und auch durch Google langfristig mit guten Platzierungen belohnt werden.